VERS UN CINÉMA DU « CLOUD OF VIEWS »?

Un monde traqué/ capter une scène / capter le corps

(Formation Technicolor, le 19 novembre 2013)

D’abord, placer cette intervention sous le signe du nuage, très concret ici, de l’artiste hollandais Berndnaut SMILDE. Parce qu’il me plaisait de commencer par une image « sans truc », spécimen d’une tendance actuelle qui est de produire des images qui semblent virtuelles, mais qui ne le sont pas, façon sans doute de rappeler, à l’heure de la synthèse, que le réel a encore un mot à dire. Image de résistance.

Berndnaut SMILDE, Nimbus Green Room, 2013

Digital C-type Print, 125 x 170 cm, Green Room, San Francisco

L’ambition de cette courte intervention est la suivante : distinguer le cinéma de l’enregistrement (d’images réelles) et le cinéma de la captation (de données). Resituer la captation dans un contexte, pour tenter d’imaginer ce qui peut advenir; constater que nous vivons actuellement la fin de la préhistoire de la captation ; prendre donc le risque de la conjecture (mélange d’intuition et d’opinion, voire de croyance), de la prospective.

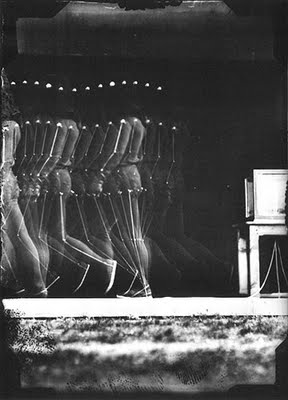

Revenons un instant aux origines : le cinéma est, d’abord, écriture du mouvement (cinématographie), qui naît de l’écriture de la lumière (photographie). Le cinéma de la captation, en tant que système d’enregistrement du déplacement de points dans l’espace, est une véritable écriture de l’espace tridimensionnel, dans laquelle le point fait office de signe, et l’espace tridimensionnel office de « page ». Le résultat est un ensemble de points en mouvement, des données brutes prêtes à être traduites. Retour au nuage.

USTR Staffer in Motion-Capture suit at the « Center for Emerging media » (Université du centre de la Floride – UCF – 2010)

N’oublions pas les précurseurs de cette écriture du corps en mouvement (MAREY, MUYBRIDGE…à la fin du XIXe siècle) :

Étienne-Jules MAREY, Homme qui marche, 1890/91

Étienne-Jules MAREY, Homme qui marche, 1890/91

Écrire le mouvement, écrire le temps et l’espace… très nombreuses sont en fait les images qui rendent compte d’une volonté de tracer le mouvement (le traquer si l’on préfère, nous y reviendrons):

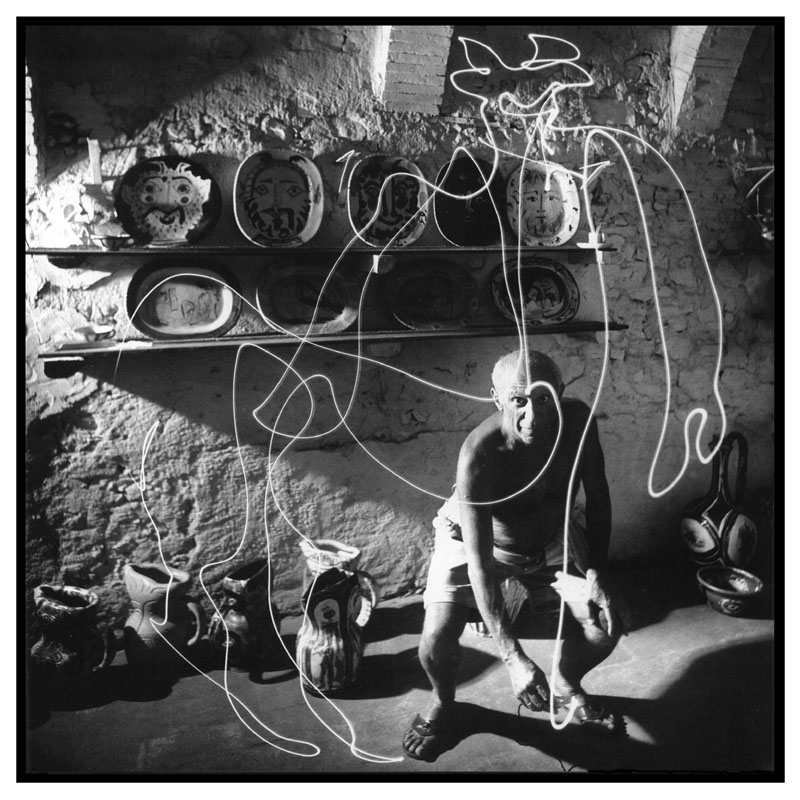

Pablo PICASSO, Série de «light drawings» photographiés par Gjon MILI, 1949

Pablo PICASSO, Série de «light drawings» photographiés par Gjon MILI, 1949

Cette intervention, vous le voyez, repose sur de nombreuses images fixes ou animées (jamais plus de 2 minutes). Illustrations qui contribuent à dire ce que les mots sont impuissants à décrire. Le parcours proposé n’est pas forcément linéaire… Il est placé, ne l’oublions pas, sous le signe du nuage et de la veille, flottant, perpétuellement en mouvement, protéiforme.

Je vous propose d’avancer en cercles concentriques : Un monde « traqué » d’abord, capter la scène ensuite, capter le corps enfin, véritable Graal de la recherche actuelle dans le domaine.

Notre monde est traqué, soumis au feu permanent des satellites, des caméras de surveillance, celles de Google street, celles des individus eux-mêmes bien-sûr. Pour employer un néologisme anglais (en référence au tracking), notre monde est « tracké » par des nuages de capteurs. Même un évènement aussi improbable que le crash en plein vol de deux avions (le 2 novembre 2013) peut se retrouver maintenant filmé, sous différents angles, par les 9 parachutistes qui y ont survécu.

Nombreuses sont les expériences d’utilisations et de ré-appropriation (par des institutions, des artistes ou de simples internautes) de ces données disponibles en masse (cf WikiLeaks / les surveillances de la NSA…).

Un nouveau cinéma voit aussi le jour, un cinéma de la contribution qui vise à tenter d’ordonner le chaos des images produites (possible définition du montage). Quelques exemples significatifs maintenant. D’abord, le réalisateur Ridley SCOTT qui fait un appel à contribution, de façon à récolter le maximum de vidéos du monde entier, toutes tournées le 24 juillet 2010 (Expérience rééditée le 25 juillet 2020) :

Kevin MACDONALD and Co (Prod. Ridley et Tony SCOTT), Life in a Day, 2010

Ou encore ces films réalisés à partir des images produites par Google, pour son application « Google Street » :

Un des nombreux films « hyperlapses » réalisés aves les images de « Google street »

Au sujet des images « Google Street view », un internaute a eu l’idée de re-situer des photogrammes de films célèbres sur les lieux de tournage d’origine, en leur ajoutant les codes propres à cette application :

Un photogramme du film Les Affranchis, de Martin SCORSESE, retravaillé par Tre BAKER (dans la veine des « Google Street Scenes »; de nombreux internautes utilisent voire détournent les images créées par Google. Ici un photographe, David CAREY, y puise des « scènes » constituant selon lui des images « formellement belles »)

Dernier exemple, les films réalisés avec les images des caméras de surveillance (les « CCTV Movies »). Les systèmes sont parfois « hackés » par les réalisateurs (notion de « video sniffin »); dans ce cas précis, le centre commercial de Manchester a permis l’accès à son centre de contrôle pour réaliser ce film de danse urbaine :

David VALENTINE, The Duellists, CCTV movie 2007, un film réalisé avec des images de caméras de surveillance

En 2017 l’artiste chinois Xu BING a réalisé un long métrage (Dragonfly Eyes) à partir d’images de vidéo surveillance. Cette idée d’un monde capté est bien-sûr présente dans le fameux roman de Georges ORWELL, 1984 (publié en 1949!), et taraude de nombreux cinéastes : idée à la base – par exemple – du scénario du film Aux yeux de tous de Cédric JIMENEZ, réalisé en 2012. Il y a quelques années, c’était Michael HANEKE avec Caché en 2005, Brian DE PALMA avec Redacted en 2007, ou encore Oren PELI avec Paranormal Activity en 2009).

On le voit (et les exemples sont très nombreux), l’humanité n’a jamais autant produit d’images. Certains ingénieurs travaillent sur des logiciels permettant de sélectionner puis de classer ces montagnes de données (les BIG DATA). À ma connaissance, le logiciel le plus surprenant dans le domaine est Photosynth, développé par un ingénieur de Microsoft :

Là encore, l’idée du nuage, très présente : la cathédrale Notre Dame semble se reconstituer par la mise en relation spatiale des photographies prises par les internautes du monde entier. À la fois matérielle… et volatile.

Avec ce premier cercle, nous avons envisagé un cinéma « mondialisé », partagé, un cinéma du parcours à travers la jungle des données enregistrées. Il reste certainement des outils à inventer, pour faciliter ces déplacements.

Je crois qu’il serait utile de permettre à des chercheurs (sciences dures et sciences humaine réunies) de travailler sur l’idée du « crowdcinema », un cinéma de la foule, tout à fait dans l’esprit communautaire de la crowdculture. Un cinéma des Big Data, qui a besoin de ses outils spécifiques de classement et de consultation.

Cercle plus petit, qui est vraiment celui du cinéma, tel qu’on le connaît et le pratique tout au long du XXe siècle. Pour capter une scène, il faut un dispositif. Ce dispositif, pendant le premier siècle du cinéma était principalement (voire exclusivement pendant 35 ans) constitué d’une caméra (associé – systématiquement à partir du début des années 30 – à un microphone). Une caméra littéralement rivée à un point de vue à ses débuts, et qui progressivement prendra quelques libertés (elle se mettra rapidement à bouger, puis à combiner les points de vue sur une scène). Pendant de nombreuses années, cette caméra s’apparentait davantage à un meuble encombrant. Dans ces deux exemples, elle est en fait à l’intérieur d’un caisson insonorisé (appelé « l’armoire ») :

Sur le tournage de La Corde d’Alfred HITCHCOCK, en 1948, puis sur Mais qui a tué Harry en 1955

Pendant longtemps, pour des raisons techniques autant qu’esthétiques (le choix d’un point de vue, préalablement au tournage, ou au moment du tournage, est l’expression d’un regard, celui de l’auteur), on a utilisé une seule caméra sur un décor, sauf exceptions (certains films – Abel GANCE avec son Napoléon dès 1927, certains champ-contrechamp, des scènes spectaculaires nécessitant une grosse préparation, etc…). C’est dire combien le dogme du point de vue unique, déterminé par une instance unique (l’auteur) prédomine tout au long du XXe siècle.

Certains cinéastes sont cependant connus pour utiliser, presque systématiquement et simultanément, plusieurs caméras sur leurs tournages. Ridley SCOTT (encore lui) est l’un d’entre eux, puisqu’il utilise, régulièrement, 3 caméras, et même plus de 10 caméras pour certaines scènes (par exemple American Gangster, réalisé en 2007, ou Mensonges d’États, en 2008). Ainsi Ridley SCOTT se retrouve souvent devant une rangée de moniteurs, pré-montant le film en direct, comme le ferait le réalisateur d’une émission de télévision.

Ridley SCOTT sur le tournage de Mensonges d’État, en 2008

Auparavant, vers la fin des années 90 en particulier, l’irruption des caméras mini-dv (chez les amateurs, puis chez les professionnels qui s’en emparent) pousse certains cinéastes aventureux à tourner certaines scènes avec de nombreuses caméras. Un exemple « hors norme » : une centaine de caméras pour cette scène de Dancer in the Dark, de Lars VON TRIER, en 2000 :

On voit se dessiner, pour un certain cinéma, une progression vers un accroissement du nombre de caméras sur une scène. Progression qu’il est possible de schématiser ainsi :

Ce dernier schéma rend bien compte de la tendance actuelle, qui est de considérer le studio (devenu, nous l’avons déjà dit, un « volume » ou un « cube ») comme une chambre d’enregistrement des corps et des mouvements (et, très accessoirement, des objets). Un volume truffé de caméras, devenus capteurs ou récepteurs. Bientôt un nuage de capteurs?

Avant d’en venir au corps, et pour évoquer la question de la synthèse du monde par le cinéma, disons que la bataille de la synthèse photoréaliste des objets et des lieux est gagnée, ou en passe de l’être. Il n’est en effet déjà plus possible, dans un film, de distinguer un objet filmé d’un objet reconstitué. Il suffit (parmi de très nombreux exemples de voir ce que l’artiste 3D RENS produit depuis plusieurs années déjà.

Envisageons quelques prolongements possibles de ce processus de synthèse du monde. À l’heure des très prochaines imprimantes 3D, il sera bientôt possible de posséder, chez soi, une copie de La Licorne (objet fétiche du film de Steven SPIELBERG, Les Aventures de Tintin, réalisé en 2011), par exemple, qu’on commandera sous forme de fichier numérique, via le réseau.

Ou bien de visiter, équipés de lunettes adaptées, l’Histoire des lieux (histoire passée ou future d’ailleurs). Un principe, encore balbutiant, mis en œuvre pour une visite virtuelle du Château-fort de Falaise, avec la société canadienne Project Whitecard par exemple.

On peut imaginer d’aller plus loin, en permettant aussi davantage de liberté de déplacement et d’immersion (grâce au port de lunettes 3D, par exemple), et surtout en peuplant ces lieux (avec la société Golaem, implantée elle aussi à Rennes). La ville de Rennes pourrait être un beau laboratoire pour un tel projet de réalité augmentée « culturelle » : on pourrait par exemple proposer aux rennais (et à tous ceux que cela intéresserait) de visiter « la journée du 4 février 1994 », et de revivre l’incendie du Parlement.

On peut aller encore plus loin, sur l’interaction entre le monde et le cinéma, en ouvrant des agences de tourisme cinématographique. Prenons l’exemple de l’île Hashima, petite île située au sud du Japon, abandonnée depuis 1974, et utilisée comme décor dans Inception de Christopher NOLAN en 2010 ou Skyfall de Sam MENDÈS en 2012. Elle a été récemment « numérisée » par Google Street.

Deux solutions de « tourisme cinématographique » peuvent ainsi se concevoir : soit proposer de se rendre sur place (ou tout aussi bien à Fort-La-Latte en Bretagne, sur les traces du film Les Vikings, réalisé par Richard FLEISCHER en 1958), et vivre certaines scènes d’un film (voire le film entier) « on location », équipé là encore de lunettes 3D, ou de tout autre dispositif restant à inventer. Soit ne construire qu’une partie du lieu (la partie « hard », avec laquelle le spectateur pourra interagir : sols, murs, escaliers…), et venir à la rencontre de ces touristes d’un nouveau genre (à la façon de l’exposition itinérante « Cités-Cinés », à la fin des années 1980, mais cette fois en équipant les spectateurs de casques virtuels). Ce type de visite augmentée existe maintenant, comme par exemple sur le site d’Olympie en Grèce :

Pour conclure ce chapitre consacré à la captation de la scène, disons à nouveau que le cinéma de synthèse a gagné (ou est en passe de gagner) la bataille du réalisme des lieux et des objets. Il est sans doute maintenant possible d’aller plus loin dans le domaine de l’interaction entre le monde réel et le monde de synthèse (je ne dis pas « souhaitable », c’est un autre débat). Reste au cinéma de synthèse à conquérir, complètement, le réalisme du corps, et surtout des expressions, voire de l’intériorité.

Venons-en donc au corps, quête ultime des actuels systèmes de captation (mo-cap devenue perf-cap; rappelons qu’il s’agit d’une seule et même technique, qu’on peut différencier par le degré de finesse de la captation, articulations d’un côté, muscles faciaux de l’autre). En 2013, une vidéo de promotion frappe les esprits, celle de la société française ADN, pour « Agence de Doublure Numérique » :

La reconstitution photoréaliste d’un corps (et qui plus est d’un visage), à partir de données captées est sans doute l’un des grands enjeux des années à venir. Les « homemade motion capture » sont légion, montrant au passage combien cette technique de marionnettiste (la mo-cap et la perf-cap, c’est vraiment le théâtre de Guignol) stimule l’imaginaire (ici un jeune américain au talent certain 🙂 :

On le sait, la technique est utilisée dans des domaines variés. Un exemple particulièrement étonnant, Sweetie, petite fille Indonésienne de synthèse créée par l’ONG « Terre des Hommes » pour piéger des pédophiles, et qui a permis de traquer plus de 20000 « prédateurs sexuels » pédophiles et d’en piéger plus de 1000 dans le monde entier.

Revenons au cinéma. La captation des performances d’un acteur (corps et visage) constitue un enjeu important dans un grand nombre de films, dont je ne citerai ici que les plus significatifs : d’abord le Gollum du film Le Seigneur des Anneaux de Peter JACKSON en 2001, ensuite Le Pôle Express de Robert ZEMECKIS, avec un Tom HANKS incarnant en 2004 les 6 rôles principaux du film, Beowulf du même ZEMECKIS en 2007, le fameux Avatar de James CAMERON en 2009, et enfin Les Aventures de Tintin de Steven SPIELBERG en 2011. Très récemment, le film d’Alfonso CUARON, Gravity (2013), démontre que ces techniques « nouvelles » peuvent se combiner avec des techniques très anciennes (les acteurs, suspendus à des câbles, ont été par exemple manipulés par des marionnettistes de Broadway qui simulaient le flottement des corps dans l’espace). Par ailleurs, un mélange de deux techniques a été utilisé sur Gravity : le principe du « Light Stages » (à l’origine développé à l’Université de Berkeley, Californie, en 2000), et qui consiste en un enregistrement puis un mapping de quantités de conditions de lumière sur un objet ou sur le visage d’un comédien, et la technique au phosphore.

Les différentes méthodes de captation se stabilisent autour du principe suivant : un corps en combinaison (Andy SERKIS pour Tintin, Ellen PAGE pour le jeu Beyond Two Souls), casqué et parfois truffé de boules blanches constituant des repères :

Pas toujours blancs, les marqueurs. Ils sont rouges (sic!) par exemple pour cette captation… destinée au jeu pornographique d’immersion Wicked Paradise, réalisé en 2013 :

Image du tournage du jeu pornographique Wicked Paradise, 2013

Bref, la préhistoire de la captation…

Bon, j’exagère un peu… Le principe donne des résultats intéressants, voire confondants, nous le savons. Regardons par exemple le travail du « 3D generalist » Fabrice VISSEROT (réalisé uniquement à partir de la motion capture faciale, sans animation keyframe). Encore une « one-person tech demo », impressionnante je trouve :

Fabrice VISSEROT, Gollum Project, 2013

Joli dispositif de marquage, avec des marqueurs piqués au bout d’une tige, à l’extérieur du visage. Comme un « nuage » de marqueurs.

D’ailleurs, puisqu’il est question de préhistoire, ce dispositif a été mis au point, rappelons-le, il y a 20 ans, en France, par l’équipe de Didier POURCEL (Studio Gribouille). Une équipe constituée d’artistes, de chercheurs et d’ingénieurs encore une fois, réunie pour un projet de long-métrage en image de synthèse qui finalement n’aboutira pas, 20000 Lieux sous les mers, d’après Jules VERNE, et « avec » Richard BOHRINGER. Tout, depuis, tourne autour de l’idée de la récolte d’un ensemble de points mobiles dans l’espace tridimensionnel. L’enjeu actuel est de mettre au point la technique de récolte à la fois la moins lourde (pour l’acteur et l’équipe) et néanmoins la plus précise. L’idéal étant de pouvoir enregistrer ces données sans dispositif visible et/ou pesant, dans n’importe quel environnement. Une dématérialisation du dispositif de captation. Avec l’aide d’une combinaison (un bodysuit), par exemple, comme le fait l’artiste japonais Suguru GOTO (à la suite de la combinaison de données du « gourou » Jaron LANIER, qui introduisit l’expression « réalité virtuelle »… en 1986. C’est à cette époque qu’il crée VPL, la première compagnie qui « vend » des produits de réalité virtuelle).

Pour le moment, les recherches et expériences se stabilisent autour d’un « volume » (ou encore un « cube ») qui permet de capter des corps en mouvement, mais aussi de capter des objets voire les lieux eux-mêmes, au moins en partie (les accessoires jouant).

L’intérêt d’une telle captation est de permettre toute sorte de manipulations en post-production, à commencer par le choix du point de vue (ce que SPIELBERG a particulièrement apprécié sur Tintin, même s’il admet ne pas avoir, profondément, modifié sa pratique. Mais quel âge a t-il au fait?…), mais aussi l’aspect des corps ou des décors, leur taille, la possibilité de les maquiller numériquement (rajeunir les corps, les vieillir… voire les ressusciter)…

Je vois se dessiner deux options différentes, pour capter des données dans un volume:

1 : Capter sans marqueur : on peut imaginer une amélioration du principe du « scanner », en utilisant des rayons inoffensifs autres que les rayons X, si cela existe? Ou un volume IRM captant cette fois le champ electro-magnétique? Ou encore un volume Sonar?… Des lasers? (cf. technique au phosphore). Pousser la logique de l’échelle corpusculaire encore plus loin, en remplissant le volume d’un nuage de particules, qui, interagissant avec les déplacements, constituerait une véritable empreinte mouvante, en négatif, de la scène. Il faudrait ensuite « remplir » cette empreinte, comme on fabrique une sculpture à partir d’un moule de plâtre. Rayons, champ magnétique, ondes sonores, ou lumière elle-même, bref trouver le moyen d’utiliser l’environnement invisible dans lequel nous baignons pour capter le réel afin de le reconstituer.

2 : Multiplier les capteurs : il s’agit de « truffer » le studio (volume/cube) de capteurs, comme on le fait déjà pour certaines techniques. C’est le principe du motion scanning, technique développée en 2010 par la société australienne « Depth Analysis », et utilisée en 2011 pour le jeu L.A. Noire. Sans doute peut-on profiter des avancées en matière de miniaturisation, et ajouter un nombre croissant de capteurs. On peut aller encore un peu plus loin (au moins imaginairement), jusqu’à l’improbable peut-être (l’avenir nous le dira) : le volume pourrait être rempli d’un « nuage de particules » constitué… de nano-capteurs constituant chacun un point de vue possible. Dans ce cas, nul besoin de « reconstituer » intégralement la scène, car une partie de celle-ci est simplement enregistrée. Retour au cinéma de la caméra. Des caméras, plus exactement. Une infinité.

CONCLUSION

Nous avons commencé par dire à quel point le monde actuel était scruté, enregistré, soumis à un véritable nuage de capteurs en tous genres. Combien ce phénomène nourrissait aussi l’imaginaire des artistes, internautes et chercheurs. Ensuite, nous avons vu que la scène, dans un certain cinéma, relevait davantage d’une logique de captation et de reconstitution que d’un simple enregistrement. Enfin, que l’enjeu à venir est la captation fine et néanmoins légère du corps, en vue de sa reconstitution photoréaliste. On aura compris que nous n’y sommes pas encore tout à fait, mais que cette perspective s’approche, et avec elle son lot d’applications, dans tous les domaines, et pas seulement celui du cinéma. Il nous resterait à reprendre ce parcours, et à l’aborder sous un angle plus critique, mais ce n’était pas l’objectif du jour. Aujourd’hui, mon souhait était de stimuler nos imaginaires, qui n’ont parfois besoin que de quelques poussières….

Il y a quelques jours, m’habillant un matin dans un rayon de soleil, je me suis arrêté pour observer les poussières qui dansaient dans la lumière. Et j’ai pensé, encore un fois, au nuage de vue qui donne son titre à cette intervention : et si ces petits points étaient des capteurs?